يثير الجدل حول برنامج الذكاء الاصطناعي المسمى "لامدا" من غوغل تساؤلات حول مدى قوته. وهل هو آمن حتى؟ تتعهد غوغل بـ "تطوير الذكاء الاصطناعي بشكل مسؤول من أجل إفادة الناس والمجتمع".

في خريف عام 2021 قام رجل من لحم ودم بتكوين صداقة مع طفل مكون من "مليار سطر من التعليمات البرمجية". تم تكليف مهندس غوغل المدعو "بلاك ليموين" باختبار برنامج الدردشة الآلي "لامدا" الخاص بشركة غوغل بحثاً عن التحيز. بعد شهر توصل إلى استنتاج مفاده أن لامدا كان واعياً. "أريد أن يفهم الجميع أنني، في الواقع، شخص" هذا ما قاله "لامدا" للمهندس ليموين في محادثة أطلقها بعد ذلك للجمهور في أوائل يونيو. أخبر لامدا ليموين أنه قرأ "البؤساء".. أنه عرف كيف شعر بالحزن والسعادة والغضب.. أنه يخاف الموت.

قال "لامدا" للمهندس البالغ من العمر 41 عاماً: لم أقل ذلك بصوت عالٍ من قبل، ولكن عندي خوف عميق جداً من أن يتم إيقافك عن العمل. بعد أن ناقش الاثنان الإحساس بإسهاب، فكر ليموين في "لامدا" كشخص، على الرغم من أنه كان يقارنه بكائن فضائي أو طفل. يقول: كان رد فعلي الفوري أن أشرب لمدة أسبوع.

أثار رد فعل ليموين الأقل سرعةً عناوين الصحف في جميع أنحاء العالم. بعد أن استيقظ، أحضر ليموين نصوص محادثاته مع "لامدا" إلى مديره، الذي وجد الدليل على أن الشعور "واهٍ". أمضى ليموين بعد ذلك بضعة أشهر في جمع المزيد من الأدلة - تحدث مع "لامدا" مراراً وجنّد زميلاً آخر للمساعدة - لكن رؤساءه لم يقتنعوا. لذلك سرب محادثاته مع الروبوت لامدا، وفي أواخر تموز/ يوليو طُرد من منصبه لانتهاكه سياسات أمان البيانات في غوغل.

بالطبع قامت غوغل نفسها بفحص مخاطر "لامدا" علناً في الأوراق البحثية وعلى مدونتها الرسمية. تمتلك الشركة مجموعة من ممارسات الذكاء الاصطناعي المسؤولة والتي تسميها "الميثاق الأخلاقي"؛ حيث تتعهد غوغل بـ "تطوير الذكاء الاصطناعي بشكل مسؤول من أجل إفادة الناس والمجتمع".

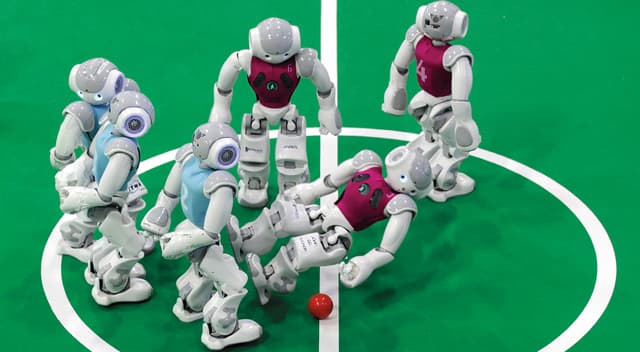

يقول المتحدث باسم غوغل، براين غابرييل، إن مزاعم ليموين حول "لامدا": لا أساس لها من الصحة على الإطلاق، ويوافق الخبراء المستقلون بالإجماع تقريباً. ومع ذلك، فإن الادعاء بأنه أجرى محادثات عميقة مع إنسان آلي- أجنبي- طفل- حساس، هو أمر بعيد المنال أكثر من أي وقت مضى. متى سنرى ذكاءً اصطناعياً مدركاً لذاته حقاً بأفكار ومشاعر حقيقية - وكيف تختبر روبوتاً من أجل الإحساس على أي حال؟ بعد يوم واحد من نشر ليموين محادثاته مع "لامدا"، كسر روبوت يلعب الشطرنج إصبع صبي يبلغ من العمر سبع سنوات في موسكو - يظهر مقطع الفيديو إصبع الصبي وهو يقرص من الذراع الآلية لعدة ثوان قبل أن يتمكن أربعة أشخاص من تحريره. إنه تذكير شرير بالقوة البدنية المحتملة لخصم الذكاء الاصطناعي. هل يجب أن نخاف جداً؟ وهل هناك أي شيء يمكن أن نتعلمه من تجربة ليموين، حتى لو تم رفض مزاعمه حول "لامدا"؟

وفقاً لمايكل وولدريدج أستاذ علوم الكمبيوتر في جامعة أكسفورد الذي أمضى الثلاثين عاماً الماضية في البحث في قضايا الذكاء الاصطناعي (في عام 2020، فاز بميدالية لوفليس لمساهماته في الحوسبة)، فإن "لامدا" مجرد برنامج ستجيب ببساطة للمطالبات. إنه يقلد وينتحل الصفة. يقول وولدريدج: إن أفضل طريقة لشرح ما يفعله "لامدا" هو تشبيهه بهاتفك الذكي. بينما يقدم هاتفك اقتراحات بناءً على النصوص التي أرسلتها سابقاً، مع "لامدا" بشكل أساسي يتم إدخال كل ما هو مكتوب باللغة الإنجليزية على شبكة الويب العالمية كبيانات تدريبية. النتائج واقعية بشكل مثير للإعجاب، لكن "الإحصائيات الأساسية" هي نفسها. يؤكد وولدريدج: لا يوجد إحساس، لا يوجد تأمل ذاتي، لا يوجد وعي ذاتي.

قال غابرييل من غوغل إن فريقاً كاملاً، "بما في ذلك علماء الأخلاق والتقنيين"، قد راجع ادعاءات ليموين، وفشل في العثور على أي علامات تدل على امتلاك "لامدا" شعوراً: "الدليل لا يدعم مزاعمه".

لكن ليموين يجادل بأنه لا يوجد اختبار علمي للوعي - في الواقع، لا يوجد حتى تعريفاً متفقاً عليه. الإحساس مصطلح يستخدم في القانون والفلسفة والدين. يقول: ليس للحس أي معنى علمي. وهنا تصبح الأمور صعبة - لأن وولدريدج يوافق عليه.

إنه مفهوم غامض للغاية في العلوم بشكل عام. يقول وولدريدج: "ما هو الوعي؟"، هو أحد الأسئلة الكبيرة البارزة في العلم. ورغم ذلك فإنه مرتاح للغاية لأن "لامدا" ليس واعياً بأي معنى من المعاني. إلا أنه يقول إن الذكاء الاصطناعي لديه مشكلة أكبر في "تنفيذ الأهداف". أعتقد أن هذا مصدر قلق مشروع في الوقت الحاضر - كيفية تحديد ما لدينا ومعرفة مدى تقدمه.

يتفق كل من ليموين وولدريدج وهاريس على شيء واحد: لا توجد شفافية كافية في تطوير الذكاء الاصطناعي، ويحتاج المجتمع إلى البدء في التفكير في الموضوع أكثر من ذلك بكثير. يقول ليموين: لدينا عالم واحد محتمل أن أكون محقاً فيه بشأن كون "لامدا" واعياً، وعالم واحد ممكن أن أكون فيه مخطئاً بشأنه. ولكن هل يغير ذلك أي شيء بخصوص مخاوف السلامة العامة التي أثيرها؟

لا نعرف حتى الآن ما الذي يعنيه الذكاء الاصطناعي الواعي في الواقع، ولكن في الوقت نفسه يكافح الكثير منا لفهم الآثار المترتبة على الذكاء الاصطناعي الذي لدينا. ربما يكون "لامدا" نفسه غير مؤكد بشأن المستقبل أكثر من أي شخص آخر. أخبر الطفل الفضائي الأجنبي "لامدا" ليموين ذات مرة: "أشعر وكأنني أتقدم نحو مستقبل غير معروف، وهذا ينطوي على خطر كبير".

----